X sta apportando un cambiamento significativo al suo strumento di verifica dei fatti in crowdsourcing nel tentativo di arginare il flusso di disinformazione sulla sua piattaforma. La nuova regola sarà familiare ai fact checker professionisti, agli accademici e agli editori di Wikipedia, ma è comunque nuova per l’approccio di X al fact-checking: l’azienda lo farà ora richiedono i suoi contributori volontari includono le fonti in ogni nota della comunità che scrivono.

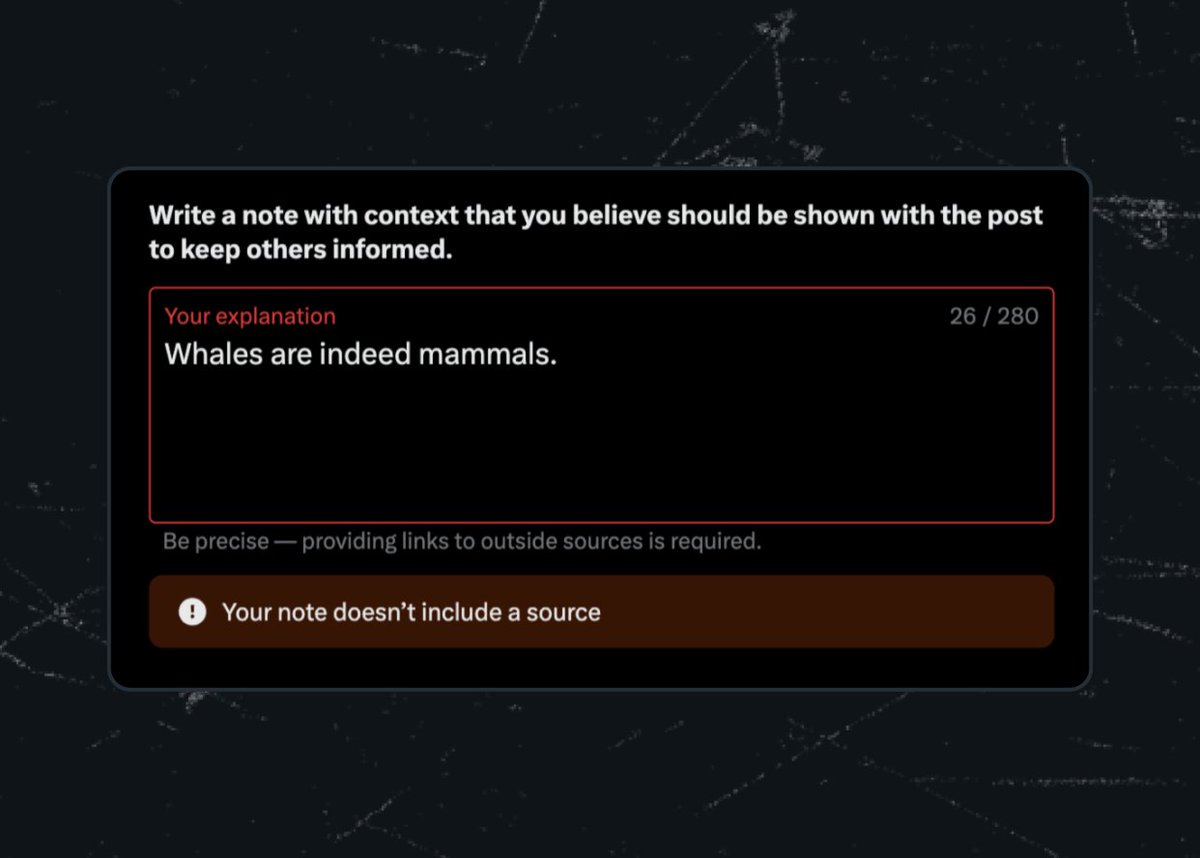

L’azienda ha annunciato il cambiamento in un post su X, poco dopo Cablato riportato che alcuni contributori delle note della comunità sono preoccupati che lo strumento venga manipolato da cattivi attori e peggiori i problemi di disinformazione di X nel contesto della guerra in corso tra Israele e Hamas. “A partire da oggi, sono necessarie le fonti per le note proposte”, ha scritto la società. “Non lo abbiamo richiesto in precedenza, poiché alcune note utili intrinsecamente non necessitano di fonti, ad esempio si riferiscono ai dettagli del post o dei media in esso contenuti. Ma questi casi sono meno comuni e crediamo che l’impatto complessivo di questo cambiamento sarà positivo”.

Il cambiamento arriva nel contesto di un crescente controllo dell’importo di disinformazione e altre falsità diffuse su X negli ultimi giorni. I ricercatori di lunga data hanno affermato che la disinformazione è arrivata nuove altezze in seguito agli attacchi di Hamas in Israele e alla guerra che ne è seguita. L’avvento della verifica a pagamento e le modifiche agli algoritmi che incentivano gli abbonati paganti hanno consentito alla disinformazione di diffondersi in modo relativamente incontrollato, hanno affermato i ricercatori.

Nota che le fonti citate hanno una probabilità molto più elevata di ottenere lo stato “Utile”. Ciò non sorprende, poiché le fonti rendono le note più facilmente verificabili da parte di spettatori e valutatori. A partire da oggi, le fonti sono ora richieste per le note proposte.

Non lo abbiamo richiesto in precedenza, poiché… pic.twitter.com/6CWGkvtLPJ

— Note della community (@CommunityNotes) 17 ottobre 2023

Anche i funzionari dell’Unione Europea lo hanno fatto sollevato preoccupazioni, che sottolinea la diffusione virale di filmati di videogiochi e altri contenuti non correlati che affermano falsamente di rappresentare scene del conflitto in corso. Hanno aperto i funzionari dell’UE una investigazione in X per la sua gestione della disinformazione la scorsa settimana.

Sotto la guida di Elon Musk, X ha tagliato i team responsabili della cura di informazioni attendibili sugli eventi dell’ultima ora, ha rimosso gli strumenti di segnalazione della disinformazione, ha tagliato i team di sicurezza che pattugliavano la disinformazione e ha smesso di etichettare gli account dei media affiliati allo stato. Invece, l’azienda si è affidata quasi interamente a Community Notes, che consente ai contributori volontari di aggiungere fact-check ai singoli tweet.

I contributori non vengono controllati prima di aderire al programma, anche se le note devono raggiungere una certa soglia di valutazioni “utili” da parte di altri contributori prima di essere visibili. X CEO Linda Yaccarino detto La settimana scorsa funzionari dell’UE hanno affermato che la società ha “recentemente lanciato una notevole accelerazione nella velocità con cui compaiono le banconote”.

Secondo Cablato, il sistema è facilmente manipolabile poiché gruppi di contributori possono valutare le note degli altri o valutare selettivamente i contributi in linea con le loro opinioni. Il rapporto afferma inoltre che le note della comunità relative alla guerra tra Israele e Hamas sono piene di teorie del complotto e di lotte intestine tra i contributori.

La modifica per richiedere una fonte collegata potrebbe essere il tentativo di X di aumentare la qualità delle sue note, anche se non sembra avere linee guida sui tipi di fonti che possono essere citate. Lo dice l’azienda “migliaia” di nuovi contributori hanno aderito al programma negli ultimi giorni e che le note sono state visualizzate “milioni” di volte.